Kokreative Performances in analog-digitalen Zwischenräumen

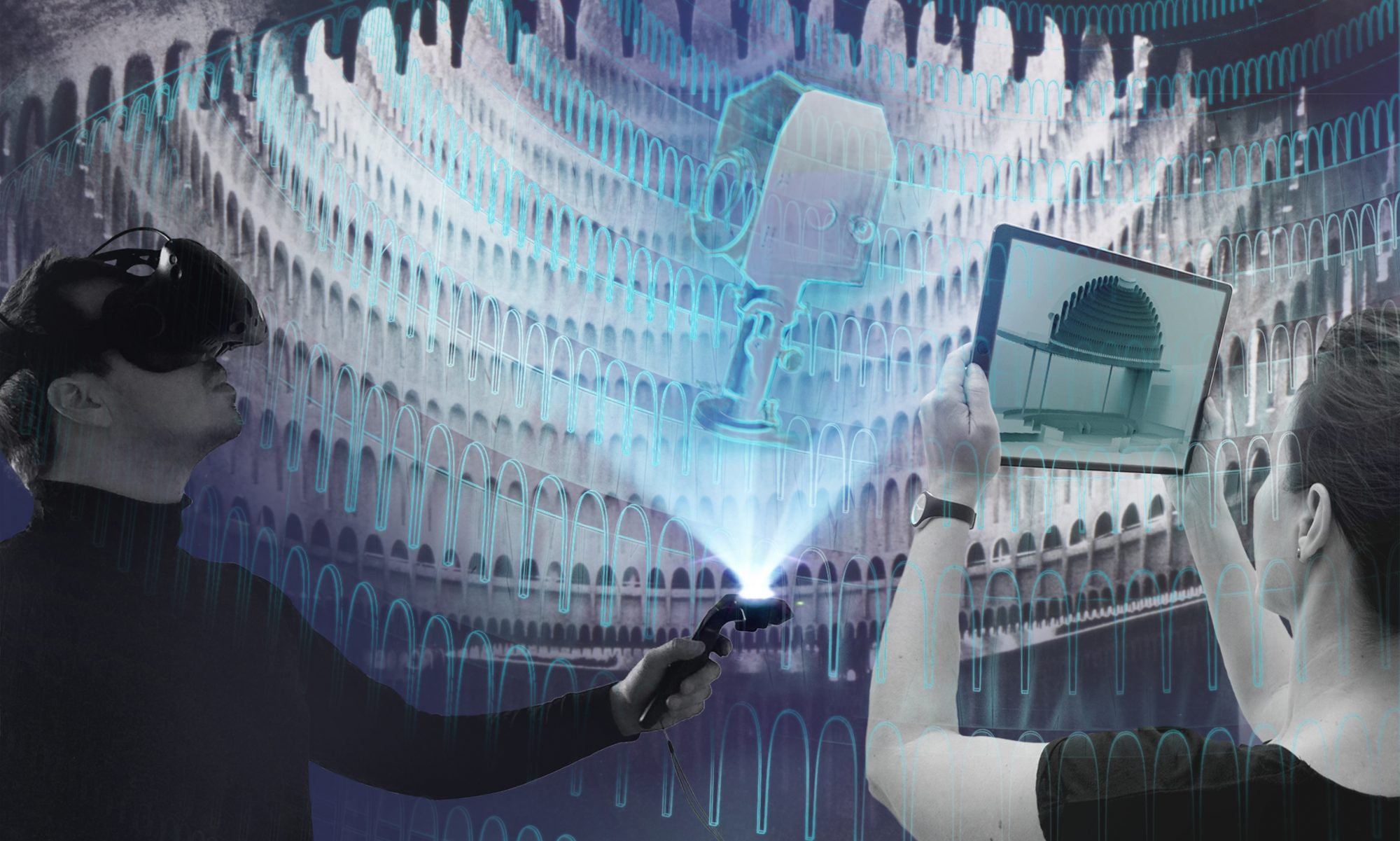

Zentrales Untersuchungsfeld in diesem Teilprojekt ist das Verhältnis zwischen physischer Realität und virtuellem Raum und Interaktionsprozessen zwischen Zuschauer:innen und Musiker:innen / Performer:innen. Mit der Entwicklung und Realisierung der VR-Performance “Spatial Encounters“ haben wir erforscht, inwiefern die Verknüpfung eines real/physischen mit einem digital/immateriellen Raum als Gestaltungsmittel eingesetzt werden kann und so neue Erlebnisräume ermöglicht werden. Ziel war die Erforschung von Kokreations-Prozessen im Rahmen von künstlerischen Inszenierungen und Performanceräumen, mit Schwerpunkt auf dem musikalischen Erleben.

Als softwareseitige Grundlage für die Performance dient eine von uns entwickelte webbasierte XR-Anwendung, die von einem lokalen Server gesteuert wird. Mobile VR-Brillen (z.B. Meta Quest 2) können über den integrierten Browser auf einen geteilten virtuellen Raum zugreifen. Darin findet die Live-Performance statt: Eine oder mehrere Musiker:innen, ein Visual Jockey als “Master of Virtual Scenography” und bis zu neun Besucher:innen begegnen sich dabei in einem gleichberechtigten Dialog. Auf einer Freifläche von circa 150 Quadratmetern taucht das Publikum mit mobilen VR-Brillen in eine virtuelle Szenerie ein, die in den darauffolgenden 20 Minuten gemeinsam bespielt, gestaltet und erlebt wird. In diesen digitalen Landschaften bewegen sie sich frei und generieren durch ihre Begegnungen und räumlichen Beziehungen visuelle Effekte und Skulpturen.

Offenen Quellcodes auf Github

Server: https://github.com/digitaldthg/Web-XR-Spatial-Encounters-Server

Client: https://github.com/digitaldthg/Web-XR-Spatial-Encounters-Client

Link zum Projekt

https://digital.dthg.de/hybrid-reale-buehnenraeume/

Wie gehts weiter?

Die experimentelle Arbeit im Umgang mit dem entwickelten Instrumentarium geht weiter. In anderen Aufführungskontexten und mit unterschiedlichen Schwerpunktsetzungen können diese neuen performativen Werkformen erkundet werden. So haben wir bereits Anfang 2022 in einem Workshop am Masterstudiengang Bühnenbild_Szenischer Raum der Technischen Universität Berlin untersucht, welche Rolle zum Beispiel Szenograf:innen in diesem Set Up einnehmen können. Welche Potenziale und Grenzen birgt solch ein gestalterisches Regelwerk? Welchen Einfluss hat die Gestaltung der Visuellen Szenerie auf das Erlebnis? Wie entwirft man für den virtuellen Raum? Die Studierenden der Technischen Universität Berlin haben eine Reihe von virtuellen Szenen gestaltet, die am gleichen Tag sofort live im Maßstab 1:1 erprobt wurden und die Stärken dieses Werkzeugs gezeigt haben.

Eine Weiterentwicklung in der Auseinandersetzung mit anderen Disziplinen, wie zum Beispiel mit Tänzer:innen und Choreograph:innen, mit Schauspieler:innen oder Puppenspieler:innen, wäre im nächsten Schritt konsequent. Ebenso ist auf musikalischer Ebene eine Erweiterung denkbar, sowohl in andere Genres, wie Jazz oder Zeitgenössische Musik, aber auch mit größeren Ensembles oder einem ganzen Orchester. Auch für die Kulturvermittlungsarbeit mit Kindern und Jugendlichen oder eine Verwendung im Sinne einer community music bietet sich das Setting an.

Aus diesen ersten Ansätzen für mögliche neue Kontexte ergeben sich neue Anforderungen an die Software: Zusätzliche Features beinhalten aus unserer Sicht eine Vereinfachung des User Interfaces, die Möglichkeit zur ortsunabhängigen Teilnahme über das Internet, die Einbindung von Audio-Streams, weitere Interaktionsmöglichkeiten für das Publikum und einen Zuschauer-Modus für passive Besucher:innen.